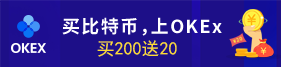

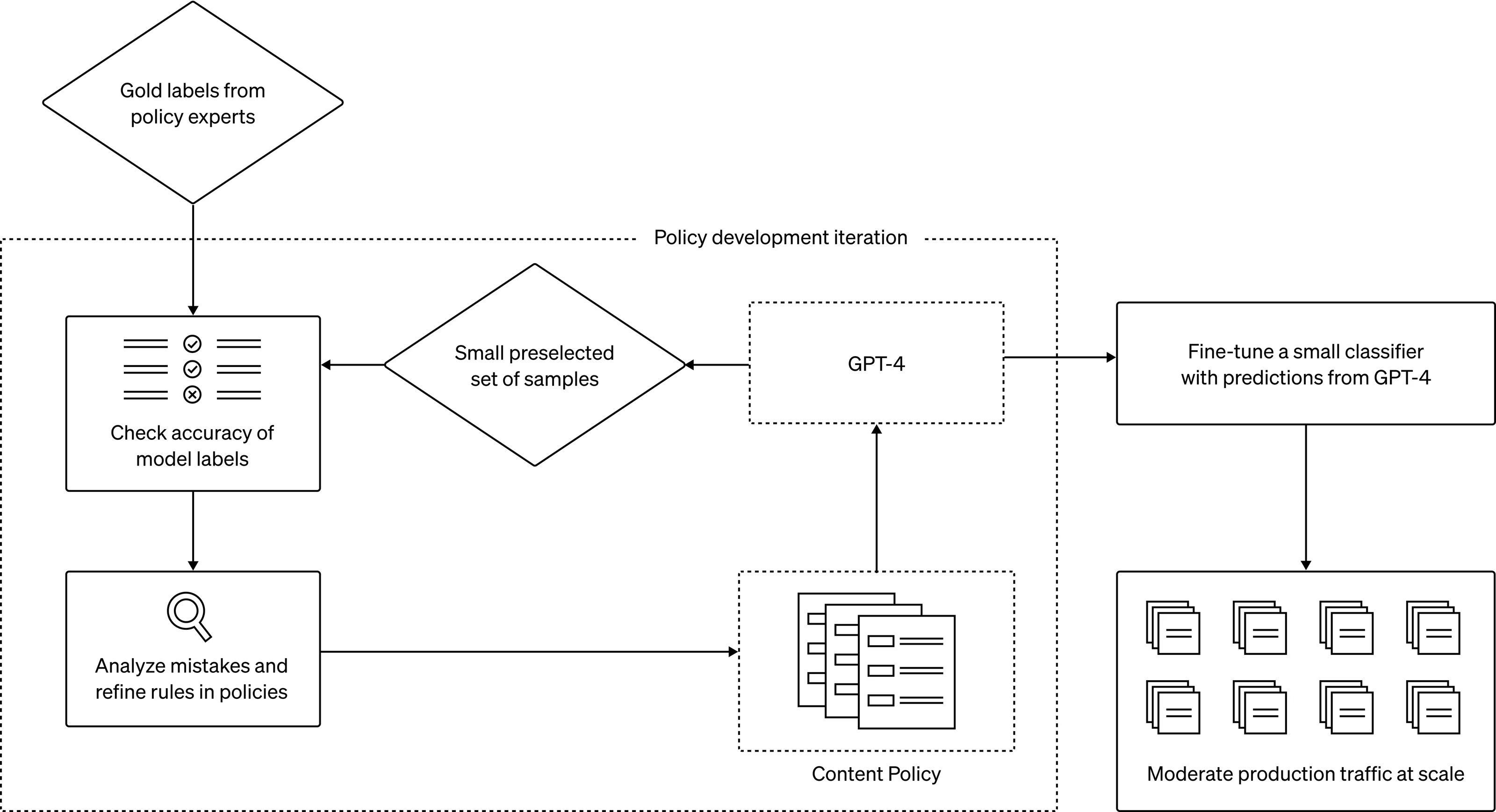

图片来源:由无界 AI 生成 8 月 16 日,OpenAI 团队发布了一种新的 AI 用途,即使用 GPT-4 进行内容政策制定和内容审核决策,从而实现更一致的标签、更快的政策细化反馈循环,并减少人工审核者的参与。 内容审核在维持数字平台的健康发展方面发挥着至关重要的作用。 OpenAI 研究人员发现使用 GPT-4 的内容审核系统可以更快地迭代策略更改,将周期从几个月缩短到几个小时。 同时,GPT-4 还能够解释长内容策略文档中的规则和细微差别,并立即适应策略更新,从而产生更一致的标签。 这为数字平台的未来提供了更积极的愿景,AI 可以根据平台特定的政策帮助调节在线流量,并减轻大量人类调节者的身体和精神负担。 哪类用户可用:任何拥有 OpenAI API 访问权限的人都可以实施这种方法来创建自己的 AI 辅助审核系统。 内容审核方面面临的挑战内容审核需要细致的努力、敏感性、对背景的深刻理解以及对新用例的快速适应,这使得这个流程既耗时又具有挑战性。 传统上,这项任务的负担落在了人类管理者身上,他们在较小的垂直特定机器学习模型的支持下,筛选大量内容以过滤掉有毒有害材料。 这个过程本质上是缓慢的,并且可能会给人类带来精神压力。 使用大型语言模型(LLM)解决OpenAI 研究团队正在探索利用 LLM 来应对这些挑战。 他们认为其大型语言模型(例如 GPT-4)可以理解并生成自然语言,使其适用于内容审核。 这些模型可以根据提供给他们的政策指南做出适度判断。 借助该系统,开发和定制内容审核策略的过程从几个月缩短到几个小时。 一旦制定了审核政策指南,政策专家就可以通过识别少量示例并根据政策为其分配标签来创建一组黄金数据。然后,GPT-4 读取策略并将标签分配给同一数据集,但不会看到答案。通过检查 GPT-4 的判断与人类判断之间的差异,政策专家可以要求 GPT-4 提出其标签背后的推理,分析政策定义中的模糊性,解决混乱并相应地在政策中提供进一步的澄清。 我们可以重复步骤 2 和 3,直到我们对策略质量感到满意为止。这个迭代过程产生了细化的内容策略,这些策略被转换为分类器,从而能够大规模部署策略和内容审核。 或者,为了大规模处理大量数据,我们可以使用 GPT-4 的预测来微调出一个更小的模型。 这个简单而强大的想法为传统的内容审核方法提供了一些改进: 标签更加一致。 内容政策不断发展并且通常非常详细。 人们可能会对政策有不同的解释,或者一些版主可能需要更长的时间来消化新的政策变化,从而导致标签不一致。 相比之下,法学硕士对措辞的细微差异很敏感,可以立即适应政策更新,为用户提供一致的内容体验。 更快的反馈循环。 政策更新的周期——制定新政策、贴标签和收集人类反馈——往往是一个漫长而漫长的过程。 GPT-4 可以将这一过程缩短至几个小时,从而能够更快地响应新的危害。 减轻精神负担。 持续接触有害或令人反感的内容可能会导致主持人情绪疲惫和心理压力。 自动化此类工作有利于相关人员的福祉。  上图解释了如何利用 GPT-4 进行内容审核(从政策制定到大规模审核)的过程 与主要依赖于模型自身对安全与不安全的内在判断的 Constitutional AI?不同,OpenAI 的方法使特定于平台的内容策略迭代更快、更省力。  (上图)GPT-4 的打标质量与经过轻度训练的人类审核员相似(Pool B)。 然而,经验丰富、训练有素的人类主持人(Pool A)的表现仍然优于两者。 OpenAI 研究团队正在积极探索进一步提高 GPT-4 的预测质量,例如通过纳入链式推理或自我批评。 同时还在尝试检测未知风险的方法,并受 Constitutional AI 的启发,旨在利用模型来识别潜在有害内容,并给出对有害内容的高级描述。 然后,这些发现将为现有内容政策的更新或针对全新风险领域的政策的制定提供信息。 注:Constitutional AI 是由 OpenAI 前成员创建的竞争对手 Anthropic 为其大模型产品 Claude 所开发的一种机制,其旨在提供一种「基于原则」的方法使 AI 系统与人类意图保持一致,让 ChatGPT 类模型使用一组简单的原则作为指导来回答问题。 —- 编译者/作者:Kyle 玩币族申明:玩币族作为开放的资讯翻译/分享平台,所提供的所有资讯仅代表作者个人观点,与玩币族平台立场无关,且不构成任何投资理财建议。文章版权归原作者所有。 |

OpenAI 团队发布 GPT-4 的最新用法,打造内容审核系统,减少人工参与

2023-08-16 Kyle 来源:区块链网络

相关阅读:

- 河南拟定 25 家人工智能创新平台,42 家人工智能重点企业2023-08-16

- 互联网云增长焦虑,期待靠AI翻身2023-08-16

- 微软更新 AI 服务条款,9 月 30 日生效2023-08-16

- A 股 ChatGPT 概念股震荡下挫,神思电子跌超 7%2023-08-16

- 科大讯飞发布基于星火大模型的 iFlyCode 1.0 编程助手2023-08-15