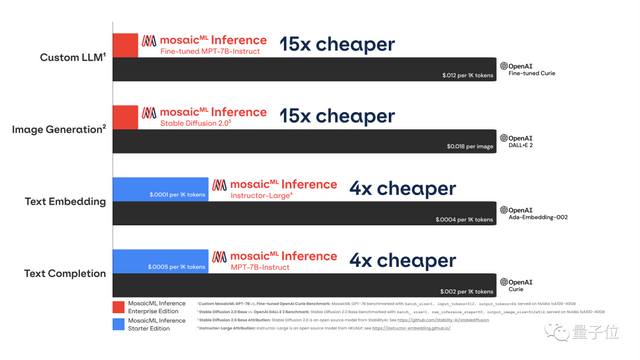

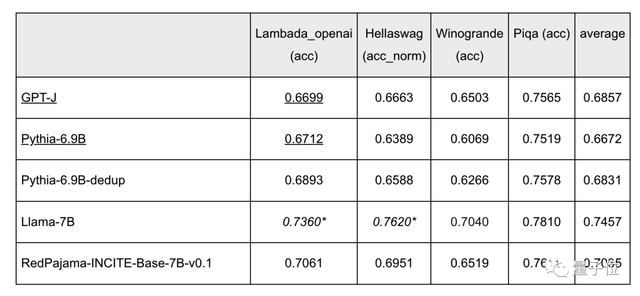

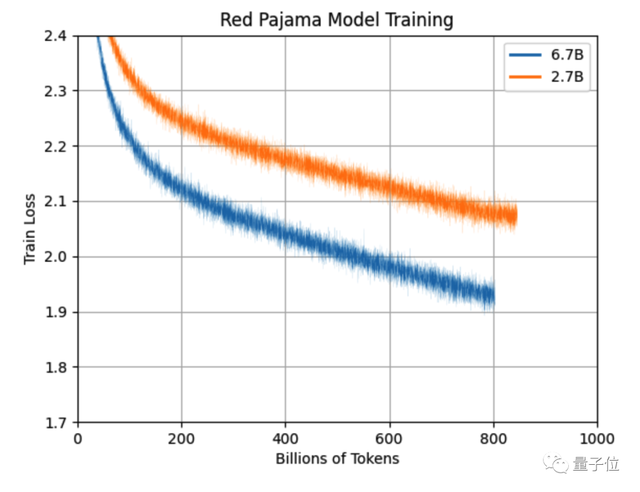

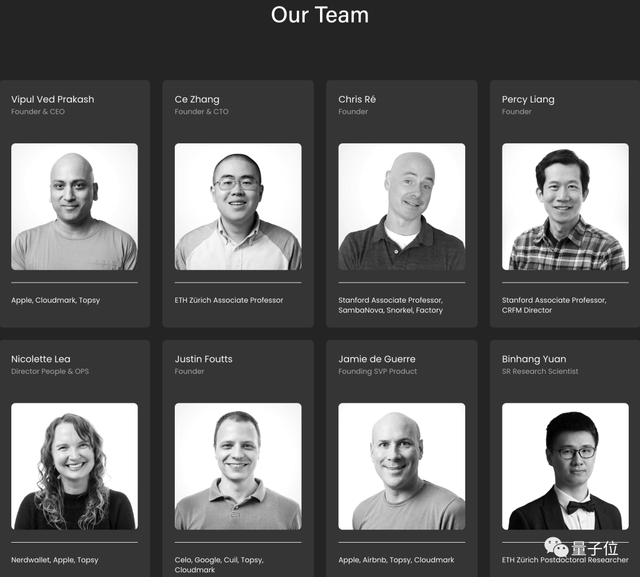

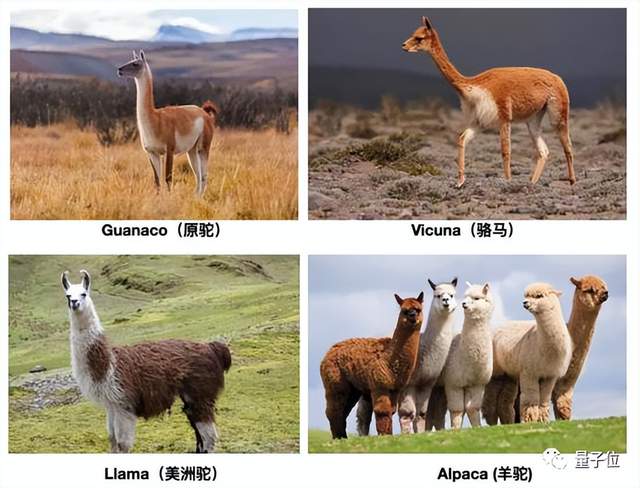

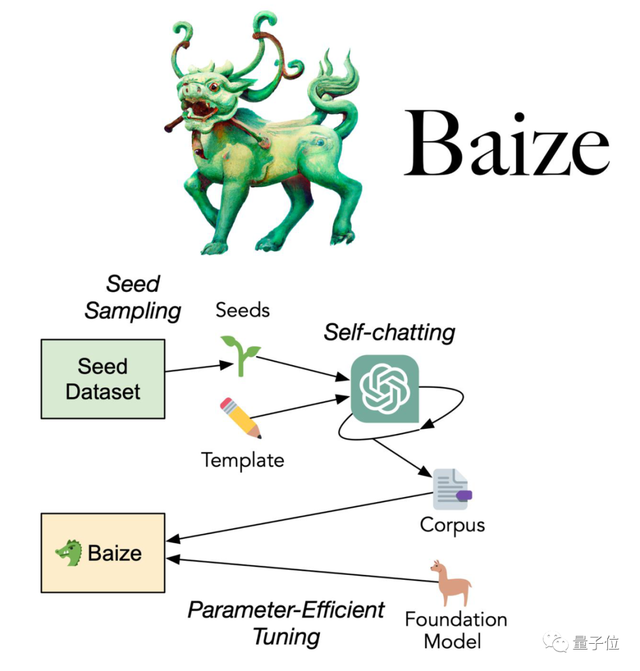

来源:量子位 从Meta的LLaMA发展出的羊驼家族一系列大模型,已成为开源AI重要力量。 但LLamA开源了又没全开,只能用于研究用途,还得填申请表格等,也一直被业界诟病。 好消息是,两大对标LLaMA的完全开源项目同时有了新进展。 可商用开源大模型来了,还一下来了俩: MosaicML推出MPT系列模型,其中70亿参数版在性能测试中与LLaMA打个平手。  Together的RedPajama(红睡衣)系列模型,30亿参数版在RTX2070游戏显卡上就能跑。  对于这些进展,特斯拉前AI主管Andrej Karpathy认为,开源大模型生态有了寒武纪大爆发的早期迹象。  MPT,与LLaMA五五开 MPT,与LLaMA五五开MPT系列模型,全称MosaicML Pretrained Transformer,基础版本为70亿参数。 MPT在大量数据(1T tokens)上训练,与LLaMA相当,高于StableLM,Pythia等其他开源模型。 支持84k tokens超长输入,并用FlashAttention和FasterTransformer方法针对训练和推理速度做过优化。 在各类性能评估中,与原版LLaMA不相上下。  除了MPT-7B Base基础模型外还有三个变体。 MPT-7B-Instruct,用于遵循简短指令。 MPT-7B-Chat,用于多轮聊天对话。 MPT-7B-StoryWriter-65k+,用于阅读和编写故事,支持65k tokens的超长上下文,用小说数据集微调。 MosaicML由前英特尔AI芯片项目Nervana负责人Naveen Rao创办。  该公司致力于降低训练神经网络的成本,推出的文本和图像生成推理服务成本只有OpenAI的1/15。  RedPajama,2070就能跑 RedPajama,2070就能跑RedPajama系列模型,在5TB的同名开源数据上训练而来(前面提到的MPT也是用此数据集训练)。 除70亿参数基础模型外,还有一个30亿参数版本,可以在5年前发售的RTX2070游戏显卡上运行。 目前70亿版本完成了80%的训练,效果已经超过了同规模的Pythia等开源模型,略逊于LLamA。  预计在完成1T tokens的训练后还能继续改进。  背后公司Together,由苹果前高管Vipul Ved Prakash,斯坦福大模型研究中心主任Percy Liang,苏黎世联邦理工大学助理教授张策等人联合创办。 开源模型发布后,他们的近期目标是继续扩展开源RedPajama数据集到两倍规模。  One More Thing One More Thing来自南美洲的无峰驼类动物一共4种,已被各家大模型用完了。  Meta发布LLaMA之后,斯坦福用了Alpaca,伯克利等单位用了Alpaca,Joseph Cheung等开发者团队用了Guanaco。 以至于后来者已经卷到了其他相近动物,比如IBM的单峰骆驼Dromedary,Databricks的Dolly来自克隆羊多莉。 国人研究团队也热衷于用古代传说中的神兽,如UCSD联合中山大学等推出的白泽。  港中文等推出的凤凰……  最绝的是哈工大基于中文医学知识的LLaMA微调模型,命名为华驼。  参考链接: [1] https://www.mosaicml.com/blog/mpt-7b [2]https://www.together.xyz/blog/redpajama-models-v1 [3]https://twitter.com/karpathy/status/1654892810590650376?s=20 —- 编译者/作者:AI梦工厂 玩币族申明:玩币族作为开放的资讯翻译/分享平台,所提供的所有资讯仅代表作者个人观点,与玩币族平台立场无关,且不构成任何投资理财建议。文章版权归原作者所有。 |

两大可商用开源大模型同时发布!性能不输 LLaMA,羊驼家族名字都不够用了

2023-05-07 AI梦工厂 来源:区块链网络

LOADING...

相关阅读:

- 天风证券:5 月之后市场或向景气趋势改善更为明显的细分赛道和 AI 赋2023-05-07

- OpenAI 发布条件生成模型 Shap-E,可用来生成 3D 资产2023-05-07

- 西门子整合微软 Azure OpenAI 服务以加强跨职能部门合作2023-05-07

- 华为:AI 将驱动各行各业“质变”,推进人工智能在各行业走深向实2023-05-07

- 昆仑万维旗下 Opera 推出全新适配 AI 的浏览器 Opera One2023-05-07