这场更贴近用户的终端侧革命,是生成式AI全民化的关键

时间:2023-09-21 来源:区块链网络 作者:机器之心

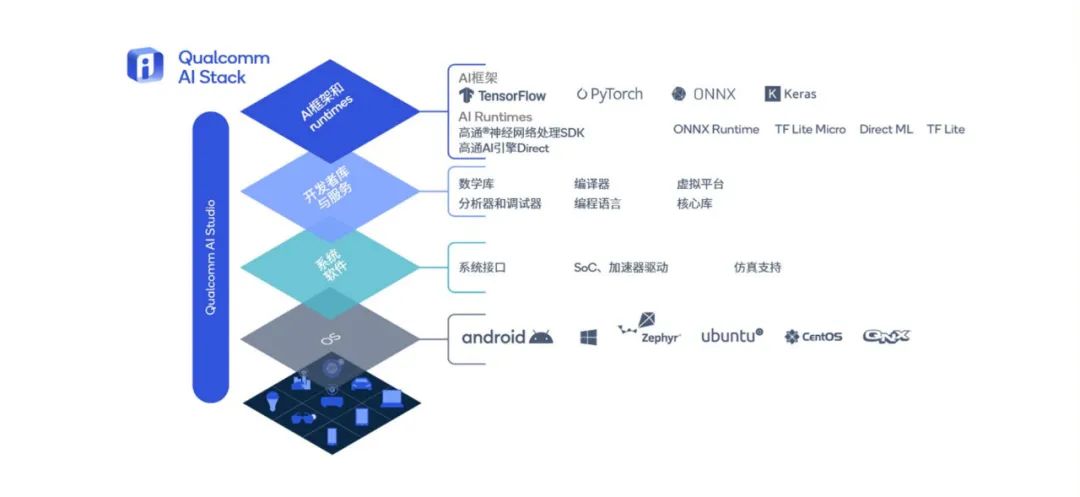

原文来源:机器之心 在生成式 AI 越来越被看好和竞相追逐的当下,它的更广泛落地,需要在终端侧做大做优做强。 图片来源:由 无界 AI? 生成 如今,距离 OpenAI 发布 ChatGPT 已近 10 个月的时间了,由它引发的生成式 AI 浪潮让普通人「更近地」感知到了人工智能的魅力。无论是大模型赋能的聊天式即时搜索引擎、还是输入文本就能生成图片的绘画工具,生成式 AI 已经慢慢走进并潜移默化地改变人们的日常工作、娱乐、创作习惯。 伴随大模型和生成式 AI 而来,手机和芯片厂商们正大张旗鼓地进行着一场「终端侧革命」。今年 5 月,谷歌发布大语言模型 PaLM 2,其中包括可以在移动设备端运行的轻量级版本 Gecko。同样是 5 月,高通发布《混合 AI 是 AI 的未来》白皮书。8 月,小米雷军宣布全面拥抱大模型,成功在手机端初步跑通 13 亿参数大模型,小爱同学也迎来大模型能力升级。 我们不禁要问,大厂们为何争相将通用及生成式 AI 大模型放进终端尤其是手机上呢?我们知道,智能手机、PC、XR、汽车等智能终端产品离普通人最近,尤其是手机,我们花在它身上的时间越来越多。2023 年 4 月,市场调研机构 Electronics Hub 发布了一份报告,显示有些国家的用户一天中盯着手机屏幕的时长超过 7 小时。手机正逐渐演变为智能生活的核心,为发展终端侧生成式 AI 准备好了「温床」。 不过,生成式 AI 大模型如今向终端侧的倾斜并非一蹴而就,在部署方式上正经历着从云到端云协同的转变。 终端与云端生成式 AI 并驾齐驱之势日益凸显我们知道,生成式 AI 大模型的参数动辄数十亿、数百乃至上千亿,在模型训练优化和执行推理方面对基础设施有极高的要求。最开始只有云端可以提供这样庞大的 AI 算力,因而厂商们往往选择在云端部署运行自家大模型。 以 ChatGPT 为例,它的训练和运行需要大量的数据存储和计算资源,海量用户请求产生高昂的算力成本,这就需要强大的云服务平台。用户可以通过微软 Azure OpenAI 云服务访问 ChatGPT 及其他生成式 AI 产品(如 CodeX)。另一大云服务商亚马逊也推出类似的生成式 AI 云托管服务,用户可以通过 API 访问 AI21Labs、Anthropic 和 Stability AI 等初创公司的预训练基础模型。 显然,云服务平台加速了这股生成式 AI 技术浪潮席卷全球,为大模型厂商提供了满足模型训练、推理所需的算力支撑。不过,大模型云端推理需要付出高昂的成本,并随着用户量及使用请求的日益增加,成本越来越高。这样一来,面对持续增加的运营成本,厂商们需要在云端之外找出另一条路出来。 随着时间推移,一方面大模型压缩技术(如量化、网络剪枝和知识蒸馏)越来越丰富且效果越来越好,另一方面手机、PC、XR、汽车等智能终端设备拥有的 AI 算力不断增强,将生成式 AI 的部署到终端的技术条件迅速成熟。终端与云端并驾齐驱之势日益凸显。  科技大厂们敏锐地捕捉到了这些变化,才有了一系列在智能手机等终端上尝试部署生成式 AI 大模型的举动。比如,ChatGPT iOS 和安卓版的推出让普通用户拿起手机便能体验生成式聊天对话,未来这样的重要时刻会更多。 此外相较于云端,在终端侧部署运行生成式 AI 还有成本、安全隐私、运行可靠等几方面的优势。 首先是成本优势。此前曾有媒体报道,OpenAI 仅维持 ChatGPT 的运行一天大约要烧掉 70 万美元,这意味着在 ChatGPT 身上可能已花费近 2 亿美元。如此高昂的成本即使是 OpenAI 也吃不消,难以实现收支平衡,更不用说盈利了。终端侧则不一样,成本大大降低,压缩后的轻量化模型部署只需支付硬件成本,不用考虑带宽、能耗、网络传输等其他问题。 其次,终端侧运行生成式 AI 可以更放心地保护隐私数据,不像云端那样有信息泄露的潜在风险。这并不是杞人忧天,今年 4 月三星被曝出半导体部门员工在使用 ChatGPT 时将数据上传到云端,导致机密数据泄露,随后宣布禁用。终端运行无需将文本、图像、视频等信息上传至云端,很好地规避了这一风险,尽量保证隐私不外泄,安全性得到增强。 低延迟也是终端侧一大优势。云端需要数据传输到云端处理后才能回传结果,过程中网络传输必然导致延迟。终端侧不需要将信息上传到云服务器或数据中心,响应速度提升,延迟也减少。同时本地运行更可靠,有时离线状态下也能运行,一定程度减少了对云服务和网络连接的依赖。 终端侧还有相较于云端更丰富的应用场景和情境信息,带来更个性化的互动和体验。用户可以针对不同的应用场景或者同一场景的不同需求微调和定制模型参数和功能,灵活性拉满。 凭借这些优势,终端侧部署生成式 AI 这条路越来越明晰,也更多地被摆在与云端同等重要的位置。正如先前高通公司全球副总裁侯明娟在《混合 AI 是 AI 的未来》白皮书线下发布会上所言,「终端侧 AI 是实现混合式 AI 架构、扩展生成式 AI 至全球更广泛范围的关键。」  侯明娟 高通这样说了,也是这样做的。在这场关乎生成式 AI 的终端侧革命中,高通率先吹起了号角,成为终端侧 AI 变革的核心推动者之一,并在布局中形成了云端与终端协同工作的混合 AI 发展路线。这一路线选择的背后更体现了高通在终端侧 AI 及生成式 AI 技术能力上的前瞻性和领导力。 先人一步布局终端侧生成式 AI所谓混合 AI,它主要有两种运作方式:一是在一些场景下,计算主要以终端为中心,在必要时向云端分流任务。二是在以云为中心的场景下,终端基于自身能力在可能的情况下分担云端的一些工作负载。云端与终端各司其能、相互辅助。 相较仅在云端,混合 AI 的最大效益在于更高效地在不同场景和时间下分配协调 AI 工作负载,提高资源利用效率,降低运行成本。 在高通的混合 AI 布局中,无论是以终端为中心、基于终端感知、还是终端与云端协同处理,都强调终端侧 AI 能力是赋能混合 AI、并让生成式 AI 实现全球规模化扩展的关键。尤其对于生成式 AI 而言,混合 AI 意味着要充分利用终端侧算力支撑起生成式 AI 应用,就像手机上的 ChatGPT 一样。 不过,在终端顺利部署运行生成式 AI 大模型说来容易、做来难,实现的前提要有强大的终端侧 AI 能力。作为上游芯片厂商,高通一直是终端侧 AI 的领导者,形成了从芯片到软件到算法再到生态的全栈 AI 优化,做到软硬件都不拖后腿,实现终端侧 AI 推理加速。  高通全栈 AI 优化 首先在硬件芯片层面,从更早的旗舰平台骁龙 888、第一代骁龙 8,到近一年来推出的高端第二代骁龙 7 和旗舰第二代骁龙 8,AI 能力持续演进、增强,端侧 AI 能力随之提升。其中不断升级的高通 AI 引擎(目前第八代)发挥重要作用,其 Hexagon 处理器、高通 Adreno GPU 和高通 Kryo CPU 面向终端侧高效运行 AI 应用而打造,并通过异构计算方式优化终端侧 AI 用户体验。 今年 10 月即将推出的第三代骁龙 8 的 AI 算力预计将进一步提升,到时能支持什么样的终端侧 AI 功能让我们更加地期待。 在持续硬件加速之外,终端侧 AI 最大的挑战在于软件,要保证可以运行各种神经处理模型,运算还要足够快、足够高效。高通 AI 软件栈帮助开发者更高效地在硬件上创建、优化和部署 AI 应用,实现一次开发、多端部署应用的效果。从下图可以看到,该软件栈从支持的 AI 框架、推理软件开发包、开发者库与服务、系统软件以及操作系统等多个层面提升开发效率。  高通 AI 软件栈 此外,在算法和模型开发方面,其致力于在不牺牲准确度的前提下提高效率,这方面有基于 Q-SRNet 模型的算法、INT4 量化解决方案等。比如,骁龙 8 Gen2 首次支持了 INT4 AI 精度格式,相较于 INT8 带来 60% 的能效提升和 90% 的 AI 推理性能提升。 高通在生态层面也持续发力,其在手机上的技术优势可以扩展到汽车、PC、XR 和物联网等其他终端。同时基于分布在各个领域的 IP 和技术,高通能够跨多个生态系统进行深入合作,比如 PC 领域与微软、XR 领域与 Meta,通过良好生态合作快速实现规模化扩展。 可以说,高通强大、全面的终端侧 AI 能力,尤其是能应对生成式 AI 模型架构潜在变化的 AI 硬件加速架构和软件栈,引领了终端侧 AI 推理,为生成式 AI 向终端扩展打下了坚实的技术基础,让生成式 AI 应用跑在手机等终端设备上成为可能。同时单就探索生成式 AI 而言,高通同样具有前瞻性。 从早期研究生成式 AI 模型的压缩方式、利用 VAE 创建视频和语音编解码器将模型规模控制在 1 亿参数以下、到无线领域用生成式 AI 替代信道模型以提升手机通信效率,高通一直在有的放矢地推进生成式 AI。 当然,成效也很显著,近半年来高通在手机端运行生成式 AI 大模型的新闻接连引发了热议,包括运行 10 亿参数的 文生图模型 Stable Diffusion、15 亿参数的 图像生成图像模型 ControlNet 等。除了展示移动端的 AI 绘画能力,高通还在数字人等其他技术方向进一步探索生成式 AI 能力的延展。  手机端 ControlNet 在 12 秒内完成渲染。 未来,高通基于积累的手机端运行经验加之 SoC 芯片算力的进一步提升,更多参数模型的终端运行指日可待。高通产品管理高级副总裁兼 AI 负责人 Ziad Asghar 接受采访时就表示,本年度将能够支持 100 亿参数的生成式 AI 模型在手机上运行。此外还将与 Meta 合作明年推出手机版 Llama 2。这些都让生成式 AI 的未来更可期。 在我们看来,终端侧 AI 最大的意义在于将生成式 AI 大模型在每个人的手中展示,对生成式 AI 的规模化扩展和普及更加有利,也能创造商业效益。仅以生成式 AI 绘画为例,如果能像前段时间火爆朋友圈的妙鸭相机一样,手机端运行生成式 AI 将产生无可估量的流量效应。 不过,高通布局生成式 AI,必然不是为了一时的流量效应,而是借助手机、移动 PC、XR 可穿戴设备、智能家居、汽车等所有可能成为生成式 AI 应用的载体,通过更贴近用户的方式,让更多的人快捷、便利地享受 AI 新体验。正如其白皮书封面所言,「让 AI 触手可及」。高通,让这一切不再遥远。 结语自 ChatGPT 以来,生成式 AI 已成为不可阻挡的发展趋势。鉴于其将为我们的生活带来极大的便利,加速普及生成式 AI 势在必行,好在高通已经打好了基础。我们了解到,高通深耕 AI 领域的时间已经超过了 15 年,尤其在移动计算领域形成了深厚的技术领导力。目前全世界有数十亿台搭载骁龙和高通平台的智能终端设备,使得终端侧 AI 试错能力、生成式 AI 应用潜力都达到了无与伦比的高度。 与此同时,通过让终端侧 AI 赋能走得更广更深,将生成式 AI 扩展到更多领域与场景,既能带给普通用户更多样化、更好玩、更便捷的 AI 体验,又可能为其智能终端生态伙伴创造更多市场商机,真正释放其价值。 对高通而言,终端侧生成式 AI 还有更为深远的意义。在此次服贸会数字贸易发展趋势和前沿高峰论坛上,高通公司中国区董事长孟樸发表了主题演讲,其中强调与全球生态系统密切合作,共同探索由 5G、AI、物联网等技术带来的全新移动应用和体验。作为当前站在风口的生成式 AI 技术,它的强弱、多寡、难易将很大程度决定这些能否顺利实现。 生成式 AI 在终端侧的运行势在必行,如高通这样的生态和用户赋能型企业也必将凭实力脱颖而出。 参考链接: https://analyticsindiamag.com/openai-might-go-bankrupt-by-the-end-of-2024/https://www.businessinsider.com/samsung-chatgpt-bard-data-leak-bans-employee-use-report-2023-5 |

玩币族移动版

玩币族移动版